ISP 论文解读 | 三星: Beyond RGB: A Real World Dataset for Multispectral Imaging in Mobile Devices (WACV 2024)

就应用而言,理解算法的边界,往往比理解算法本身更重要。

📖 阅读提示

潜在读者

- 图像/ISP算法(调试)工程师,研究人员

- 对计算摄影、颜色科学感兴趣的科研和技术人员

推荐时长

- 1min–30min

原文下载

这是多光谱AWB系列文章的第二篇,第一篇可以参考“多光谱色彩复制技术”

快速导读

面阵多光谱,是和单点多光谱传感器的对应说法,他们一般是有一些分辨率,比如150w的红枫,大概有9通道数据。类似的技术OPPO在其丹霞原彩系列中也已使用。工业界如火如荼,但是学术界发展很缓慢,其中一个核心原因是:缺乏真实的数据集

目前开源的大部分都是纯粹做多光谱研究的——这个方向和我们说的面阵多光谱不完全一样,他们的一个重要假设是:多光谱是用来真实成像的,而不是辅助测光的,而面阵多光谱,在手机成像成像领域,是辅助测光,不参与成像——我认为这是两个领域的核心区别。

非常幸运的,现在说的这篇论文,提出了一个很有价值的数据集,它太过重要,以至于都可以直接拿来当标题:

这是该数据集的简介:

- 16 通道多光谱数据 ,分辨率648x484,使用分光光度计测量得到的36维,380-730nm的真实光谱作为ground truth

- 总共 1680 场景(自然光472,人造光1208)

- 为了验证和手机成像结合光谱信息有没有提升,还在上述场景中,分别使用Samsung和OPPO手机采集了带色卡的RAW-RGB数据

那么,如何使用这些数据集,如何证明多光谱能够比单独的RGB估计的更加精准,我们看看他的具体算法。

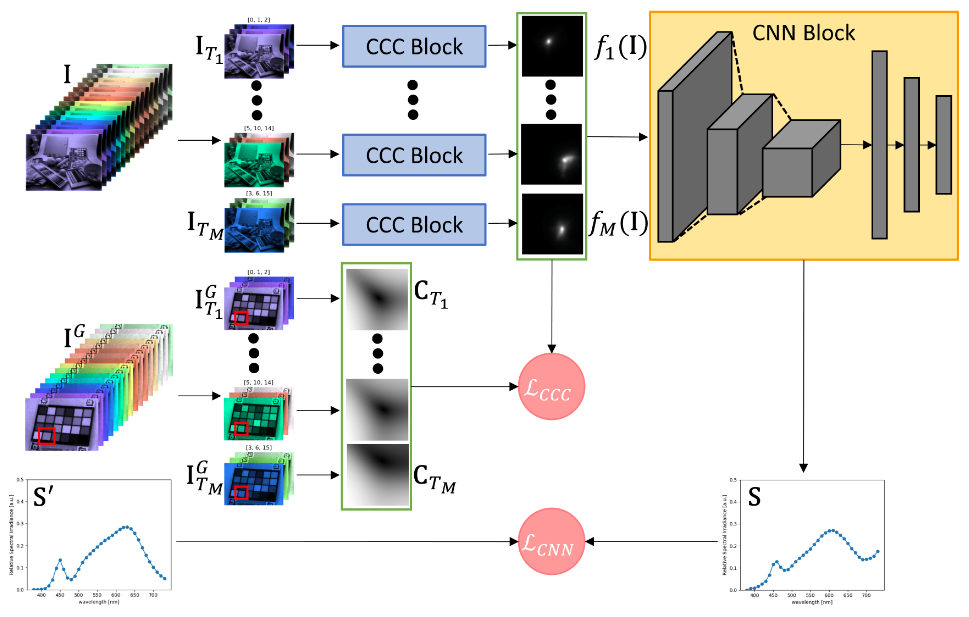

- 基线把 CCC 平移到 ISE:把 16 通道拆成多组三通道跑 CCC,再用 CNN 回归整条光源光谱。

- 三层评测:光谱域(ΔAHS)、MS 传感器域(ΔAMS)、XYZ 感知域(ΔAXYZ)。

- 结论一句话:MS 明显优于 RGB-only,MS+RGB 融合小幅更稳。

- 注意:单点光谱 GT、全局光源假设,对空间多光源不直接友好。

01 方法

{=.center}

{=.center}

通俗说:16 通道挑 21 组三通道(14 组相邻 + 7 组低重叠),每组当“伪 RGB”,每组跑一次 CCC(做 log-chroma 直方图 → 金字塔卷积 → 得到该组的 score map),然后把 21 个 score maps 拼接进 CNN,直接回归 36 维光源光谱。

总损失: $$L ;=; w_1 \sum_{i=1}^{M} L^{(i)}{CCC} ;+; w_2, L{CNN} ;+; w_3, L_{wd}$$

至于如何融合(Fusion)RGB,就更加直接了:把手机 RGB 当成“第 22 组三通道”并入上述流程。

稍微有点复杂的是为了更加公平的在不同维度评测对比,设计了以下评测matrics:

光谱域:$\Delta A_{HS}=AE(S’,S)$

MS 域:$\Delta A_{MS}$ (为16通道传感器响应投影)

XYZ 域:$\Delta A_{XYZ}$(CIE1931 CMF)

02 结果

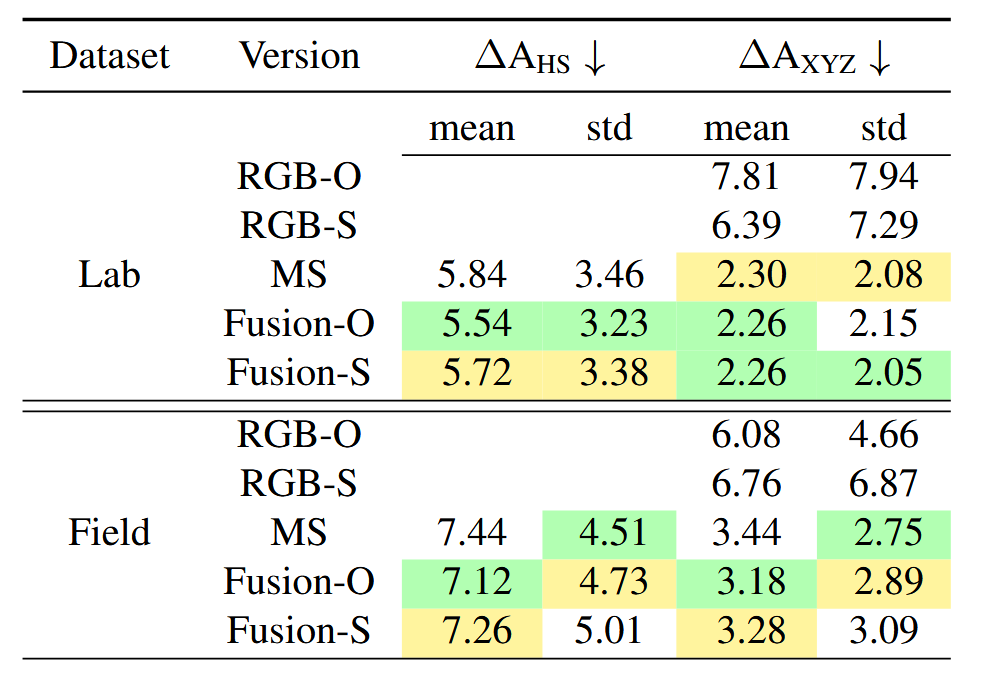

我们不是很关心和其他做光谱重构的算法比对,更加关注XYZ效果以及与RGB融合的效果。所以这里我选取了部分结果:

结论是: MS 在 Lab 与 Field 都显著优于 RGB-only;

但是:

- 融合(MS+RGB)较 MS-only几乎没有提升

- 是这里融合的方式太过于简单粗暴;

- 16维度的多光谱数据对RGB的三通道肯定是能够线性表示

- Field 误差普遍大于 Lab

- Lab数据中光谱几乎都是测量的非常精准的,但是Field环境中也许有混合光源。

- Field数据量太少(Field VS. Lab, 472:1208),过拟合了

03 评价

Pros

- 首个移动影像多光谱数据,+RGB + 光谱仪 + 色卡 + 内外参,链路完整,评测闭环;

- 16→3 的多组拆分让老牌 3 通道方法(如 CCC)能直接复用在多光谱domain;

Cons

- 数据集本身依然假设是单光源,多光源用不了——这可是面阵多光谱的一个主要优势啊

- 算法有点‘笨笨的,手动分了21个组的3通道,这个超参数也没ablation一下;

- 融合方式朴素(把 RGB 当一组三通道);可做特征级/注意力级对齐与跨相机域对齐;

04 发散

优化算法——这21 组的构造三通道,本质不就是‘手动版多头’吗?把 RGB 与 多光谱当不同模态 token,做 cross-attention,效果一定不会差吧;

肤色研究——论文强调,为了隐私,他们特意把人脸给滤波过滤了——但是多光谱下的肤色,多么重要的topic,给浪费了

改成多光源环境——传统RGB数据集,我们一般都是用relighting的方法然后线性构造多光源环境,这个多光谱是否也能这样做?

移动端影像中,最后成像还是看RGB摄像头,那么,最重要的不应该是:光源光谱知道了,结合RGB sensor的光谱灵敏度曲线不就直接积分得到了RAW white point了吗?再和RGB数据的gt做角度差,只有这样才能够衡量收益